Documentation Index

Fetch the complete documentation index at: https://docs.turinton.ai/llms.txt

Use this file to discover all available pages before exploring further.

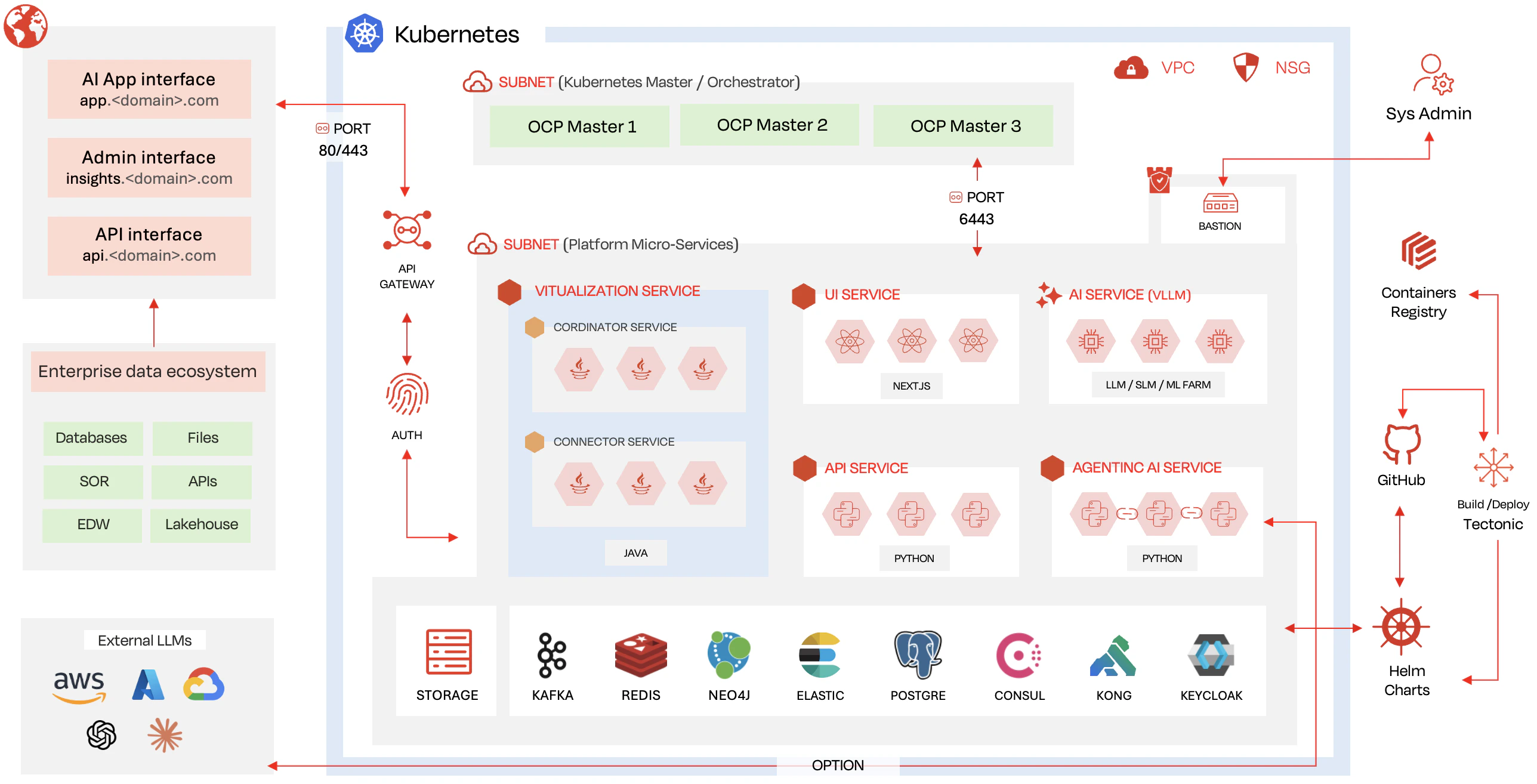

インフラ要件

| Service Category | Service Type | Description | Quantity |

|---|---|---|---|

| Compute | Kubernetes Service - System Node Pool (Masters) | 4 vCPUs, 16 GB RAM, Linux | 3 |

| Compute | Kubernetes Service User Node Pool (workers) | 16 vCPUs, 128 GB RAM, Linux | 4 - 6 |

| Storage | Persistent Store | Provisioned SSD (Premium), 3,500 IOPS, 150 MiB/sec throughput | 1 TB |

| GPU (Hosted LLM) | H100 / H200 family | 160 – 320 GB vRAM as per the concurrency requirements. 256GB RAM. 8 Core. 1 TB Storage | 3 - 4 |

| External LLMs | API / URL | No need of hardware | Min - 2 |

責任マトリックス

| # | 任務 | Turinton | クライアント/パートナー |

|---|---|---|---|

| 1 | プラットフォーム展開 | 責任者 | |

| 2 | プラットフォームトレーニング支援 | 責任者 | |

| 3 | プラットフォームの更新 | 責任者 | |

| 4 | POCユースケースの構築 | 責任者 | 支援 |

| 5 | オントロジー/コンテキストグラフの開発 | 責任者 | 責任者 |

| 6 | ログ記録と観測可能性の設定 | 責任者 | 責任者 |

| 7 | 新しいLLMモデル展開(vLLM使用) | 責任者 | 責任者 |

| 8 | 新しいユースケースの構築と配布(POC後) | 支援 | 責任者 |

| 9 | インフラストラクチャプロビジョニング | 支援 | 責任者 |

| 10 | ハードウェア要件 | 責任者 | |

| 11 | データアクセス | 責任者 | |

| 12 | インフラを監視する | 責任者 | |

| 13 | セキュリティおよびコンプライアンス管理 | 責任者 | |

| 14 | 災害復旧/バックアップ戦略 | 責任者 |